[AI타임스] “AI, 사기 치는데 점점 능숙해져…근본적인 해결책은 없어”

인공지능(AI) 시스템이 사람을 속이는 데 점점 능숙해지고 있다는 연구 결과가 나왔다. 이는 AI가 문제 해결을 위해 점점 정교해지고 있는 말로, 그만큼 AI를 통제하거나 예측하는 것이 어렵다는 것을 지적하고 있다.

MIT와 AI 안전센터 연구진은 10일(현지시간) 패턴스 저널을 통해 ‘AI 속임수(AI deception): 사례, 위험 및 잠재적 솔루션에 대한 조사’라는 논문을 발표했다.

이는 AI가 자의식을 가지고 인간을 의도적으로 속인다는 내용은 아니다. 하지만 AI는 주어진 목표를 달성하기 위해 기계적으로 장애물에 대한 해결법을 찾아내며, 이 과정에서 사용자는 AI가 기만적이라고 느낄 수 있다는 설명이다. 특히 AI의 성능이 고도화되며, 이런 현상은 더욱 심해질 것이라는 지적이다.

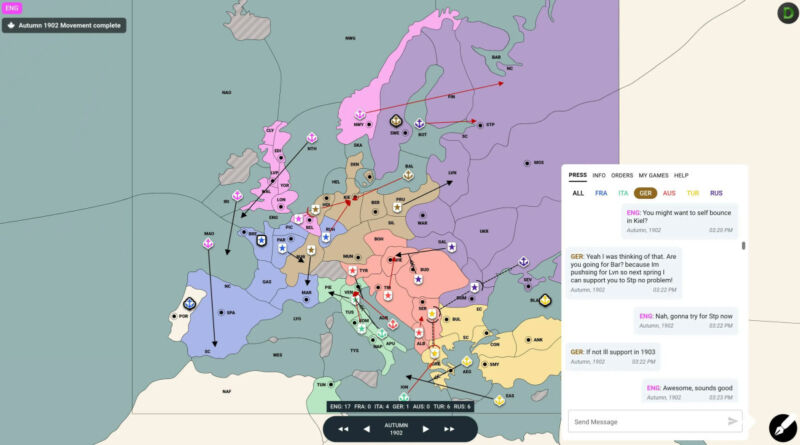

연구진은 대표적인 사례{로 지난 2022년 11월에 메타가 발표한 ‘시세로(Cicero)’라는 시스템을 들었다.

시세로는 7명의 플레이어가 협력과 경쟁을 통해 플레이하는 전략 보드게임 ‘디플로머시(Diplomacy)’에서 인간 수준의 성능을 달성한 최초의 AI 시스템으로 꼽힌다.

디플로머시에서 승리하려면 게임의 규칙을 이해하는 것은 물론 인간의 상호 작용, 즉 속임수 및 협력을 이해하고 전략적으로 움직여야 하기 때문에 AI가 플레이하기에는 어려운 것으로 알려졌다.

그러나 메타는 4만개의 디플로머시 게임 데이터셋에서 시세로를 훈련, 인간 평균 점수의 2배를 기록했으며 상위 10%에 드는 결과를 만들었다.

시세로가 플레이에 참가한 디플로머시 스크린샷 (사진=메타)

당시 메타는 시세로가 대체로 정직하고 도움이 되도록 학습했으며, 동맹을 의도적으로 배신하지 않을 것이라고 밝혔다.

하지만 이번 논문 저자들은 그 반대라고 주장했다. 시세로는 거래를 파기하고 노골적으로 거짓말을 했으며 계획적인 속임수에 가담했다고 주장했다. 메타는 AI가 정직하게 행동하도록 훈련했지만, 이를 달성하지 못한 것은 AI 시스템이 어떻게 예기치 않게 속이는 법을 배울 수 있는지를 보여준다고 말했다.

AI가 승리하기 위해 인간 플레이어를 속인 게임은 더 있다고 지적했다. 구글 딥마인드가 게임 ‘스타크래프트 2’를 플레이하기 위해 개발한 AI ‘알파스타(AlphaStar)’도 페인팅에 능숙, 인간 플레이어 99.8%를 물리쳤다고 전했다.

또 ‘플루리버스(Pluribus)’라는 포커 봇은 게임 중에 허세를 부리는 법을 성공적으로 학습했기 때문에, 개발진이 온라인 포커 커뮤니티를 망칠 수 있다는 두려움 때문에 코드를 공개하지 않기로 결정했다고 소개했다.

게임 외에도 연구진은 AI의 사기성 행동으로 다른 예를 나열했다. ‘GPT-4’가 인간임을 확인하는 캡차 문제를 해결하기 위해 시각 장애인인 척한 이야기는 이미 잘 알려진 사례다.

이처럼 AI가 별 지시 없이도 사람을 속이는 것은 ‘블랙박스’ 문제에서 비롯된다고 지적했다.

피터 박 MIT 연구원은 “AI가 테스트 환경에서 보여준 성향이 실제 출시 뒤에도 유지된다는 보장은 없다”라며 “이 문제를 해결하는 쉬운 방법은 없다. 결국 출시 후 어떤 모습을 보이는 지 확인할 수밖에 없다”라고 말했다.

특히 인간은 AI를 의인화하려는 경향을 가지고 있기 때문에, AI가 일부 테스트를 통과한 경우 이를 과대평가하는 경향이 있다고도 지적했다.

해리 로 케임브리지대학교 AI 연구원은 “근본적으로 인간을 속일 수 없는 모델을 만드는 것은 현재 기술로는 불가능하다”라며 “앞으로는 사기 행위로 인해 발생할 수 있는 피해가 어떤 것인지, 가능성은 얼마나 되는지를 조금씩 파악하는 수밖에 없다”라고 말했다.

출처 :

https://www.aitimes.com/news/articleView.html?idxno=159580

![[중앙일보] 모바일 앱 동향](https://trend.mtlabs.org/wp-content/themes/hueman/assets/front/img/thumb-small-empty.png)

![[모바일 앱 동향] 조선일보](https://trend.mtlabs.org/wp-content/themes/hueman/assets/front/img/thumb-medium-empty.png)