AI 성능 경쟁의 중심축이 더 큰 모델에서 더 효율적인 모델로 이동하는 가운데, 엔비디아가 메모리 병목을 획기적으로 줄이는 새로운 기술을 공개했다. 특히, 얼마 전 구글이 공개해 화제가 됐던 ‘터보퀀트(TurboQuant)’의 메모리 6분의 1 압축보다 더 큰, 메모리 사용량 10.7배 감소라는 수치를 제시했다.

엔비디아와 MIT 연구진은 6일(현지시간) 대형언어모델(LLM)의 핵심 한계로 지적돼 온 ‘KV 캐시(KV cache)’ 문제를 근본적으로 개선하는 접근법 ‘트라이어텐션(TriAttention)’을 온라인 아카이브를 통해 공개했다.

KV 캐시는 AI가 이전 대화와 데이터를 기억하기 위해 사용하는 메모리 공간으로, 문맥이 길어질수록 사용량이 폭발적으로 증가해 GPU 메모리를 빠르게 소진시키는 병목으로 작용해 왔다. 이로 인해 AI는 긴 문서나 복잡한 추론을 수행하다가 ‘메모리 부족’ 상태에 빠지는 경우가 많았고, 이는 실제 상용화의 가장 큰 물리적 제약 중 하나로 꼽혀왔다.

기존 연구들은 메모리 부담을 줄이기 위해 중요하지 않은 정보를 제거하는 압축 기법을 제시해 왔지만, 성능 저하라는 치명적인 문제가 있었다. 특히 RoPE(위치 인코딩)가 적용된 이후에는 데이터가 이미 뒤섞인 상태가 되는데, 이 상태(Post-RoPE)에서 중요도를 판단하다 보니 필요한 정보까지 함께 지워지는 문제가 생겼다. 이는 복잡한 수학 문제나 장기 추론에서 AI 성능이 급격히 떨어지는 원인이었다.

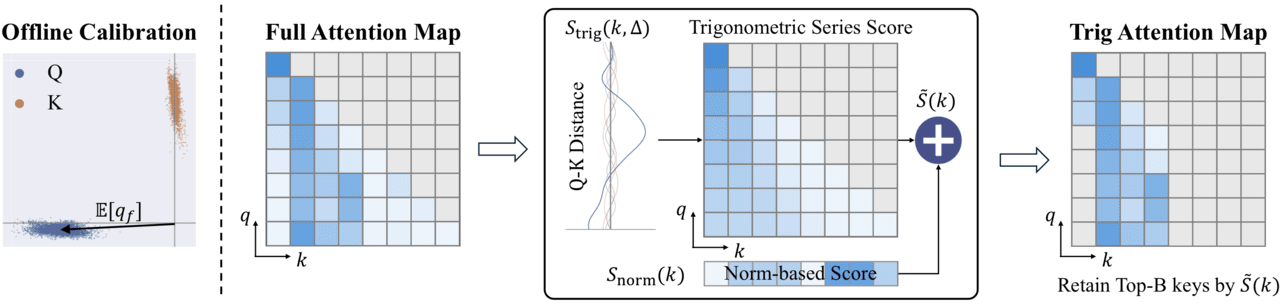

트라이어텐션은 이 문제를 해결하기 위해 데이터가 뒤섞인 상태(Post-RoPE)에서도 수학적으로 그 패턴을 역추적할 수 있다는 점에 주목했다. 기존 연구들은 위치 정보(RoPE)가 입혀지면 데이터 상관관계가 복잡해져 핵심 정보를 골라내기 어렵다고 보았으나, 엔비디아 연구진은 수학적 필터(TriA-Filter)를 통해 뒤섞인 데이터 속에서도 ‘Pre-RoPE’ 단계의 중요한 특징을 정확히 식별해 낼 수 있음을 증명했다.

이를 통해 별도의 추가 학습 없이도 불필요한 데이터만 골라 삭제하는 정교한 최적화 로직을 완성했다.

핵심은 삼각함수를 활용한 분석 방식이다. AI가 어떤 위치의 정보를 중요하게 볼지를 ‘거리 패턴’으로 예측해서, 필요한 데이터만 골라 남긴다. 이는 기존처럼 모든 데이터를 하나씩 비교하는 대신 수학적인 필터로 빠르고 효율적으로 걸러내는 방식이다.

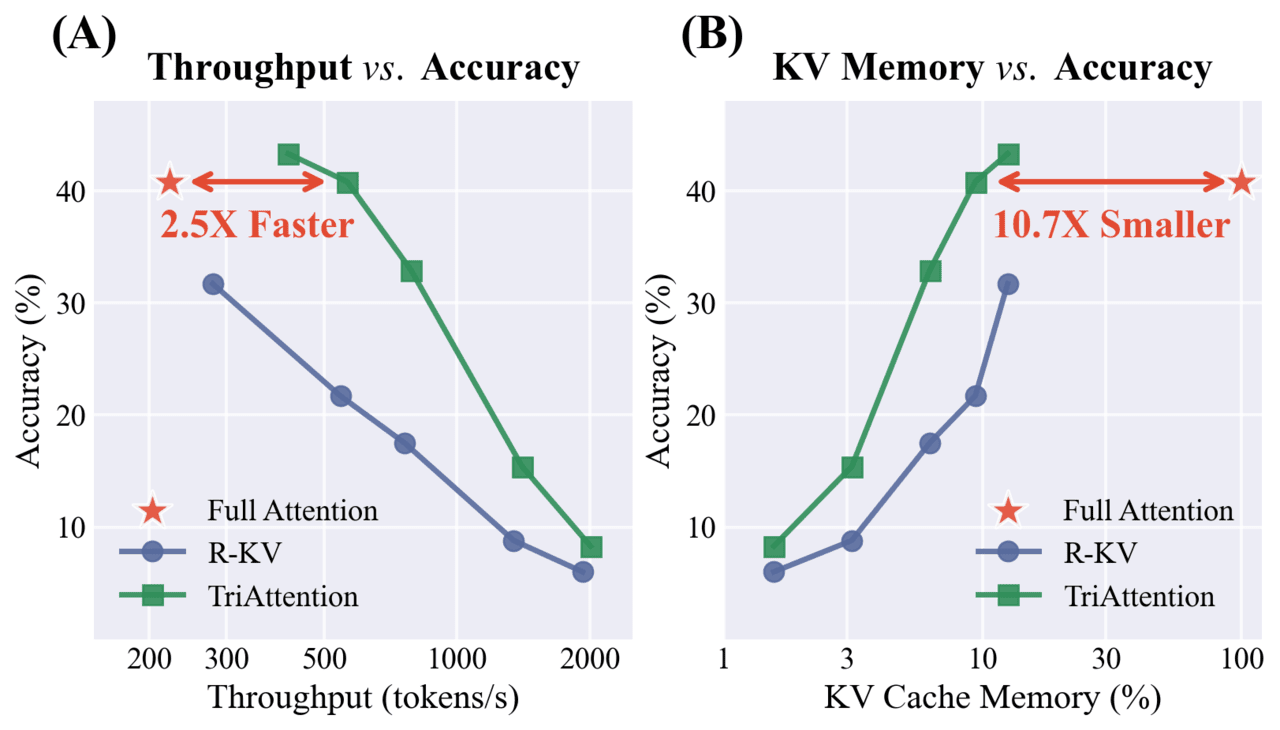

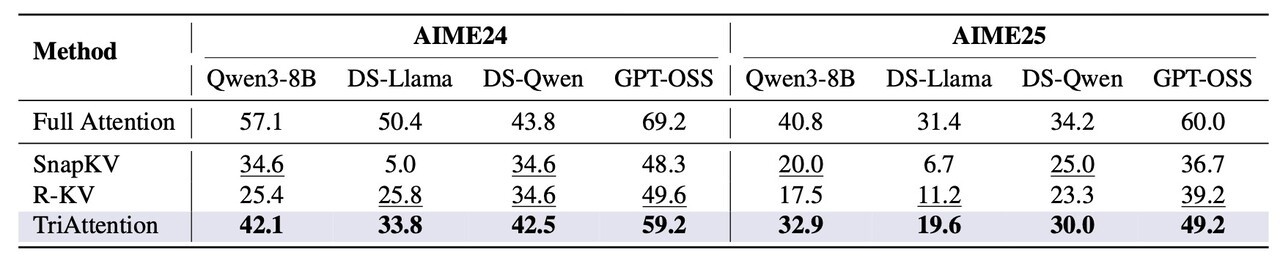

실험 결과는 인상적이다. 고난도 수학 추론 테스트인 ‘AIME25’에서 트라이어텐션은 기존 풀 어텐션(Full Attention) 대비 정확도를 유지하면서도 KV 캐시 메모리를 10.7배 줄였다.

또 메모리 절감 대신 속도에 집중할 경우 최대 2.5배 빠른 처리 성능을 기록했다. 이는 단순한 트레이드오프가 아니라, 효율성과 성능을 동시에 확보한 결과로 평가된다.

특히 책 한권 분량인 3만2000 토큰의 초장문 환경에서도 정확도를 유지하며 장기 추론 안정성을 입증했다.

이 기술의 파급력은 실사용 환경에서 더욱 크다. 기존에는 320억(32B) 매개변수급 모델을 긴 문맥으로 실행하려면 다수의 GPU가 필요했지만, 트라이어텐션을 적용하면 일반 소비자용 GPU(24GB VRAM 등) 한장으로도 실행 가능해진다.

이는 개인 PC에서도 고성능 AI를 구동할 수 있는 길을 열었다는 의미다. 특히 ‘오픈클로(OpenClaw)’와 같은 개인용 AI 에이전트나 온디바이스 모델 확산에 중요한 전환점이 될 것으로 보인다. 엔비디아가 이 기술을 강조하는 것도 GPU 한장으로 오픈클로를 구동할 수 있다는 것을 보여주려는 의도다.

이 같은 흐름은 구글의 최근 기술과도 연결된다. 구글의 터보퀀트는 압축 기술을 사용해 KV 캐시 사용량을 6분의 1로 줄이면서도 처리 속도를 최대 8배까지 끌어올리는 성과를 냈다.

물론 두 방식은 다르다. 구글이 데이터를 6분의 1로 압축해 효율을 높였다면, 엔비디아는 수학적 필터로 불필요한 데이터를 10분의 1 넘게 골라내 버리면서도 추론 정확도를 지켜냈다는 것이 핵심이다.

또 KV 캐시 축소가 전체 메모리 사용량 감소로 직결되는 것은 아니다. 예를 들어, 전체 32GB 메모리 중 모델이 18GB, KV 캐시가 12GB, 기타가 2GB를 차지하는 구조라면, KV 캐시를 10분의 1로 줄이더라도 총 메모리는 약 21.2GB 수준으로 감소하는 데 그친다.

결국 핵심은 ‘메모리 수요가 사라진다’라는 것이 아니다. ‘같은 VRAM으로 더 긴 문맥과 더 큰 작업을 처리할 수 있다’라는 점이다.

이는 실질적인 AI 활용 범위를 크게 확장하는 요소로 평가된다.

박찬 기자

출처 : https://www.aitimes.com/news/articleView.html?idxno=208924