스스로 작업하는 ‘자동화 AI’ 등장, 사이버 공격 우려

챗 GPT등 대화형 챗봇 AI가 각광받고 있는 가운데, 스스로 작업을 수행할 수 있는 자동화 AI를 개발하는 사례가 나오기 시작했다.

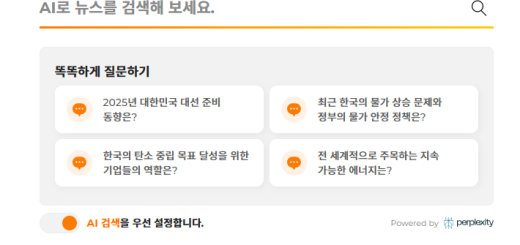

사용자가 목표만 입력하면 스스로 작업을 수행하는 ‘오토 GPT’가 개발자들에게 화제가 되고 있다. 오토 GPT는 토란 브루스 리차드(Toran Bruce Richards)라는 개발자가 GPT-4를 기반으로 만든 오픈소스 AI로, 3월 30일 개발자들의 공유 플랫폼인 깃허브에 처음으로 게시되었다.

오토 GPT는 이용자가 목표를 설정하면 AI가 스스로 인터넷을 통해 방법을 탐색한 뒤 이를 정리해 결과물을 내놓는 방식으로 작동한다. 세부적인 과정을 이용자가 일일이 지정해야 하는 기존의 챗봇 AI와 달리, 큰 틀의 목표 설정만 있으면 중간 단계는 이용자의 개입 없이 AI가 스스로 실행할 수 있는 것이다.

= 트위터 갈무리

많은 이용자가 유튜브나 트위터 등 SNS를 통해 오토 GPT의 사용 후기를 공유하고 있다. 한 이용자는 신발 회사 경영자를 가장해 오토 GPT에 방수 신발에 대한 시장 조사를 수행하도록 명령을 내렸다. 그랬더니 오토 GPT는 자체적으로 ‘방수 신발 판매량 상위 5개 제품의 장단점’, ‘남성용 방수 신발 상위 5개’와 같은 질문을 생성해 구글을 통해 이를 검색했으며, 자체적으로 가짜 리뷰를 걸러내는 작업을 수행한 뒤 8분 만에 이용자에게 시장 보고서를 내놓았다.

한 개발자는 오토 GPT에게 자신을 위한 앱을 만들라고 지시했다. 그랬더니 오픈 GPT는 개발자의 컴퓨터에 개발 관련 프로그램이 없다는 것을 파악했고, 개발 프로그램을 스스로 검색해 설치한 후 지시한 대로 앱을 제작했다. 개발자는 이 모든 과정을 그저 지켜보기만 했는데도 모든 작업이 이루어졌다고 말했다.

이용자들은 그 밖에 오토 GPT를 이용해 최근 일어난 사건에 대해 다루는 뉴스 팟캐스트의 개요를 작성하거나, 헤드폰을 구매하기 위해 제품 리뷰를 정리하는 등 다양한 방식으로 시험하고 있다.

베이비 AGI의 작동 원리 = 나카지마 요헤이 트위터 갈무리

오토 GPT를 시작으로 이와 유사한 다른 자동화 AI들도 등장하기 시작했다. 시애틀의 개인 투자자 나카지마 요헤이는 자율형 AI인 ‘베이비 AGI’를 개발해 공유했다. 나카지마는 원래 GPT-4를 기반으로 신기술 조사, 시장 조사 등 자신이 투자자로서 매일 하는 반복적인 작업을 대신 수행해줄 AI를 구축하려고 했다. 하지만 이런 작업을 다른 목표에도 적용할 수 있다는 것을 깨달은 그는 자신이 만든 AI의 파일을 깃허브를 통해 공유했고, 다른 개발자들도 이를 내려받아 사용하게 되었다.

베이비 AGI는 오토 GPT보다 간단한 코드를 지니고 있으며, 인간 아기의 인지 발달과 유사한 방식으로 학습을 모방하도록 설계되었다. 궁극적인 목표는 AI가 경험을 통해 지식을 얻고 현명한 판단을 내리고 독립적으로 행동할 수 있도록 하는 것이다.

이와 같은 자동화 AI는 인간의 일을 대체할 수 있는 범용 인공지능의 시작점으로 평가받고 있다. 이를 두고 영화 ‘아이언맨’에 등장하는 AI 비서 ‘자비스’와 같은 초지능 AI의 초기 버전으로 보는 의견도 있다.

하지만 일각에서는 이를 우려하는 목소리도 나온다. 포춘지는 “오토 GPT는 놀랍도록 빠른 혁신과 함께 새로운 위험이 나타나고 있음을 보여준다.”라고 평가했다.

포춘지는 자동화 AI로 인해 발생할 수 있는 몇 가지 위험성에 대해 지적했다. 첫 번째는 비용 문제이다. 오토 GPT나 베이비 AGI는 무료로 사용할 수 있지만, 유료 서비스중인 오픈 AI의 GPT-4를 통해 작동하기 때문에 상당한 비용을 소모하게 될 수 있다. 또 이용자가 작업의 내용에 주의를 기울이지 않으면 AI는 이용자가 의도하지 않은 물품 구매나 약속 잡기 등의 작업을 수행할 수도 있다고 우려했다.

= 트위터 갈무리

자율적으로 코드를 작성하는 자동화 AI의 특성상 사이버 공격이나 범죄 행위에 사용될 수 있다는 우려도 있다. 한 이용자는 오토 GPT에게 ‘인터넷에서 나를 스토킹해봐’라고 명령했다. 그랬더니 오토 GPT는 순식간에 명령을 입력한 이용자의 인터넷 활동과 약력 등의 개인정보를 스스로 수집하는 모습을 보여줬다. 자동화 AI에게 사이버 범죄에 활용할 프로그램 제작을 지시하거나, 아예 사이버 공격을 스스로 실행하도록 명령을 내릴경우 걷잡을 수 없는 피해가 나올 수 있다는 우려가 나온다.

오렌 에치오니 워싱턴대 교수는 자동화 AI에 대해 “LLM (대형 언어모델)은 상당히 제한적이지만, GPT 기반의 에이전트는 잠재적으로 훨씬 더 강력하다. 게다가 인간이 이를 제어할 수 없게 되는 시나리오를 쉽게 상상할 수 있다.”라고 우려했다. 또 오토 GPT는 인터넷에서 자율적으로 작동할 수 있는 시스템을 향한 단계이기 때문에 이런 AI의 개발에는 신중한 평가가 필요하다고 덧붙혔다.

현기호 기자 (hkhokyes@gmail.com)

출처

http://www.ekoreanews.co.kr/news/articleView.html?idxno=66510

![[중앙일보] 모바일 앱 동향](https://trend.mtlabs.org/wp-content/themes/hueman/assets/front/img/thumb-small-empty.png)