[디지털타임스] 오픈AI, 초거대AI `GPT-4` 출시…이미지 인식능력 높아지고 더 똑똑해졌다

“변호사시험에서 기존 GPT-3.5가 하위 10%를 기록했다면 새로운 GPT-4는 상위 10%로 통과한다.”

오픈AI는 새로운 LLM(거대언어모델) ‘GPT-4’를 14일(현지시간) 출시하며 이 같이 소개했다. 챗GPT 플러스(유료버전)를 통해 사용량 제한과 함께 공개되며, API(응용프로그램인터페이스) 이용의 경우 대기명단 등록을 받는다.

GPT-4는 기존 챗GPT에 쓰이던 GPT-3.5와 달리 여러 데이터 형태를 인식하는 멀티모달 모델로 출시됐다. 이제 프롬프트(제시어)에서 기존 텍스트뿐 아니라 이미지 인식도 지원, 원하는 답변을 위해 텍스트와 이미지를 함께 입력할 수도 있다. 하지만 그 결과물은 마찬가지로 텍스트로만 출력된다. 이미지 입력 기능은 아직 리서치 프리뷰라 사용이 제한됐으며, 세간의 예측과 달리 비디오는 포함되지 않았다.

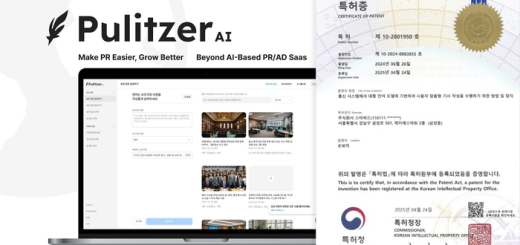

또 다른 차이점은 영어 외 언어에 대한 지원이 강화된 점이다. 오픈AI가 MS(마이크로소프트) 애저 번역을 활용한 MMLU(대규모다중작업언어이해) 벤치마크 번역 테스트를 실시한 결과, GPT-4는 전세계 26개 언어 중 한국어를 포함한 24개 언어에서 높은 성능을 보였다. 기존 GPT-3.5뿐 아니라 구글 팜(PaLM)과 딥마인드 친칠라(Chinchilla) 등 경쟁사 LLM에 대해서도 우위를 보였다는 설명이다.

GPT-4의 파라미터(매개변수) 수는 공개되지 않았다. 오픈AI는 지난 2년간 딥러닝 스택 전반을 재설계하고 MS와 함께 슈퍼컴퓨터를 공동 설계했으며, 지난해 GPT-3.5는 그 테스트의 일환으로 내놓은 것이라 설명했다. 특히 예측 가능한 확장성 확보에 주력, 동일한 방법론을 사용하면서도 훨씬 적은 연산량으로 예측이 가능하도록 했다.

오픈AI에 따르면 텍스트 생성AI들이 꾸준히 지적받는 할루시네이션(거짓말) 문제에 대해 GPT-4가 내부 평가에서 GPT-3.5보다 40% 높은 점수를 받았다. 허용되지 않는 콘텐츠 요청에 대한 응답 경향도 82% 줄였다.

하지만 회사는 여전히 GPT-4를 완전히 신뢰할 수 없다는 점을 재차 강조하며 사용자 주의를 권했다. GPT-4 역시 학습데이터 문제로 2021년 9월 이후 발생한 일에 대해서는 정보가 부족하다는 점은 이전과 마찬가지기도 하다.

오픈AI 측은 “GPT-4는 딥러닝을 확장하기 위한 자사 노력의 최신 이정표로, 많은 실세계 시나리오에선 아직 인간보다 능력이 떨어지지만 전문적이고 학술적인 벤치마크에선 인간 수준의 성능을 보여준다”며 “GPT-4가 많은 애플리케이션을 통해 활용됨으로써 사람들의 삶을 개선하는 데 가치 있는 도구가 되기를 기대한다”고 밝혔다.

GPT-4 다국어 번역 벤치마크 테스트 결과. 오픈AI 홈페이지 발췌

![[중앙일보] 모바일 앱 동향](https://trend.mtlabs.org/wp-content/themes/hueman/assets/front/img/thumb-small-empty.png)