[인공지능신문]알리바바, AI 에이전트에 ‘절차적 기억’ 부여하는 기술 공개

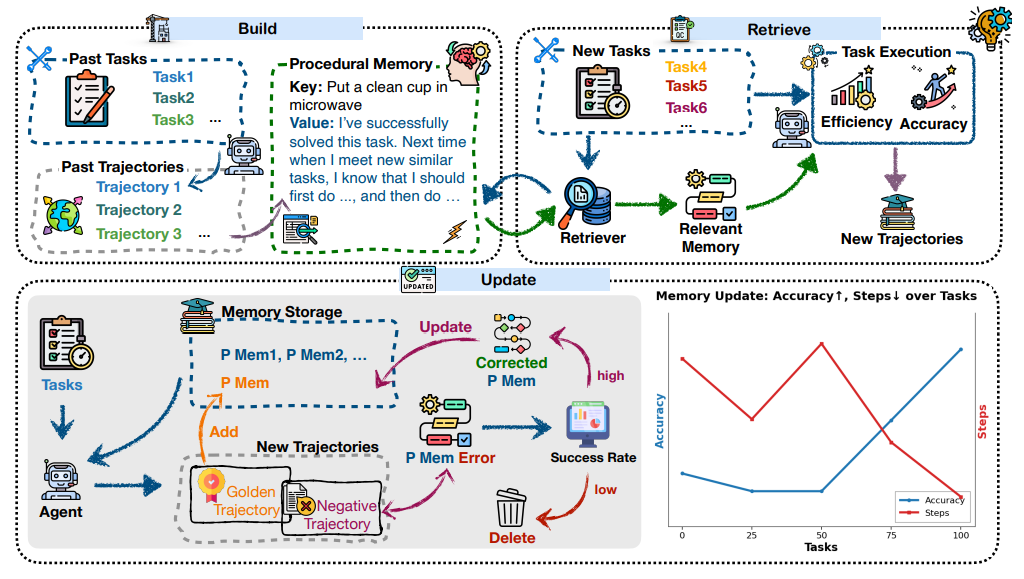

멤프 프레임워크 (사진=아카이브)

인공지능(AI) 에이전트가 사람처럼 경험을 축적해 업데이트하고 재활용하며 성능을 높일 수 있도록 돕는 동적 메모리(Dynamic Memory) 기반 대형언어모델(LLM) 기술이 등장했다.

알리바바와 저장대 연구진은 27일 AI 에이전트에 동적 메모리를 적용하는 새로운 기법 ‘멤프(Memp)’를 소개하는 논문을 아카이브에 공개했다.

이 방식은 사람이 반복 학습을 통해 점차 숙련되는 것처럼, 에이전트가 과거 경험을 바탕으로 절차적 기억(procedural memory)을 꾸준히 업데이트하며 복잡한 작업을 더 효율적으로 처리할 수 있도록 한다.

기존 LLM 에이전트는 문맥이 길거나 여러 단계로 구성된 복잡한 업무에서 성능을 제대로 발휘하지 못한다. 또 네트워크 오류나 데이터 스키마 변화 등 예기치 못한 상황이 발생하면 처음부터 다시 시작해야 했고, 이는 비용과 시간이 크게 소요되는 문제로 이어졌다.

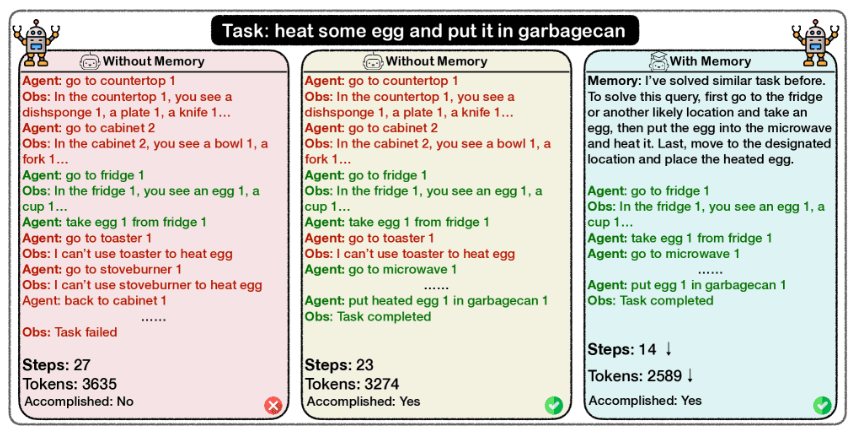

절차적 기억를 사용하면(오른쪽) 에이전트가 더 적은 단계와 더 적은 토큰을 사용하여 작업을 완료하는 데 도움이 된다. (사진=아카이브)

멤프는 이런 한계를 극복하기 위해 ▲기억 생성(Build) ▲검색(Retrieve) ▲업데이트(Update) 과정을 순환 구조로 설계했다.

에이전트는 과거 작업 기록을 정리해 단계별 지침이나 큰 흐름의 스크립트로 저장하고, 새로운 상황이 오면 비슷한 경험을 찾아 활용한다. 이후 성공이나 실패 경험을 반영해 기억을 수정하거나 지워 나가면서, 점점 더 정확하고 효율적으로 일을 처리하게 되는 구조다.

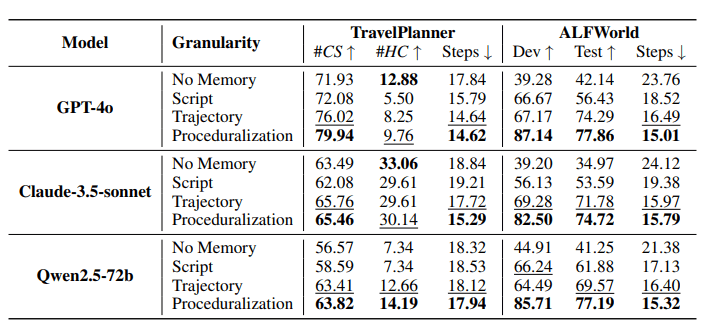

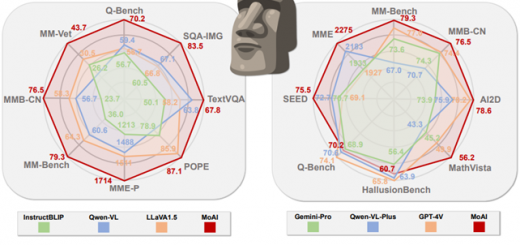

연구진은 여행 계획 시뮬레이션 ‘트래블플래너’, 가정 환경에서의 가사 수행을 다루는 ‘ALF월드(ALFWorld)’ 벤치마크에서 실험을 진행했다. 그 결과, 멤프를 적용한 에이전트는 불필요한 시행착오를 줄이고 작업 성공률과 효율성이 개선되는 것으로 나타났다.

벤치마크 결과 (사진=아카이브)

또 다른 성과는 ‘지식 이전’ 가능성을 입증한 점이다. 연구진은 대형 모델인 ‘GPT-4o’가 생성한 절차적 기억을 소형 모델 ‘큐원2.5-14B’에 이식했다.

이후 소형 모델의 성공률이 크게 높아지고 수행 단계도 줄어들었다. 이는 대형 모델이 구축한 고난도 절차적 지식을 비용 효율적인 소형 모델에 적용할 수 있음을 보여준다는 설명이다.

팡루난 논문 공동 저자는 “소형 모델은 단순한 단일 작업에는 강하지만, 장기 계획이나 추론에서 한계를 보인다”라며 “대형 모델의 절차적 기억이 이 격차를 메워줄 수 있다”라고 설명했다.

멤프는 최근 등장한 ‘Mem0’나 ‘A-MEM’ 등 메모리 기반 연구와 비슷한 맥락이지만, 차별점은 명확하다. Mem0나 A-MEM이 단일 대화나 상호작용 내에서 ‘무슨 일이 있었는지’를 기록한다면, 멤프는 다양한 경험을 종합해 ‘어떻게 해야 하는지’에 대한 절차적 지식을 일반화해 재활용한다는 것이다.

팡 연구원은 “잘된 작업 과정을 절차적 지식으로 정리해 다시 쓰면 성공률이 높아지고 과정도 더 짧아진다”라며 “특히 중요한 것은 절차적 기억을 계속 업데이트해 에이전트가 마치 사람이 연습하면서 실력을 키우듯 점점 더 완벽해질 수 있도록 길을 열었다는 점”이라고 설명했다.

출처 : https://www.aitimes.com/news/articleView.html?idxno=201903

![[중앙일보] 모바일 앱 동향](https://trend.mtlabs.org/wp-content/themes/hueman/assets/front/img/thumb-small-empty.png)

![[모바일 앱 동향] 한국경제, 매일경제](https://trend.mtlabs.org/wp-content/themes/hueman/assets/front/img/thumb-medium-empty.png)