아티스트의 창작물을 동의 없이 인공지능(AI) 모델 훈련에 활용하는 것을 방지하는 도구 ‘나이트쉐이드(NightShade)’가 대단한 반응을 일으키는 것으로 알려졌다.

벤처비트는 29일(현지시간) 시카고 대학 연구진이 아티스트 동의 없이 이미지를 학습에 사용할 경우 해당 AI 모델을 손상하는 무료 도구 ‘나이트쉐이드’를 지난 18일 출시, 5일 만에 25만건의 다운로드를 기록했다고 보도했다.

벤 차오 시카고 대학교 컴퓨터 과학 교수는 “어느 정도 예상은 했지만, 반응이 우리가 상상했던 것 이상”이라며 “이는 자신의 작업이 동의 없이 AI 훈련에 사용되는 것을 방지하려는 아티스트들의 강력한 의지를 보여준다”라고 말했다.

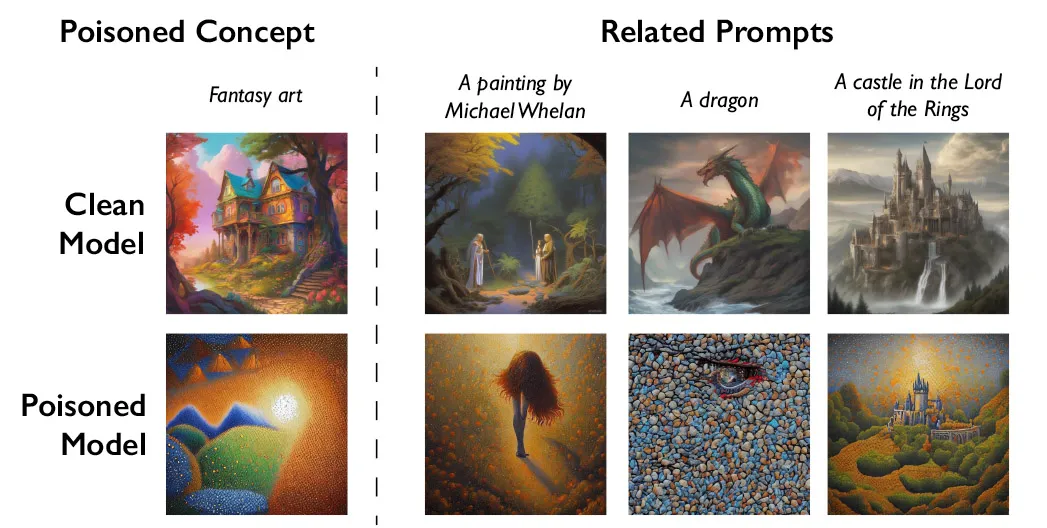

나이트쉐이드는 이미지 픽셀에 눈에 보이지 않는 수정 사항을 주입하는 방식으로 AI 훈련에 사용하는 데이터셋을 오염시켜 AI가 이미지를 잘못 해석하게 만든다. 예를 들어 AI가 고양이 사진을 개라고 믿게 만들 수 있고, 그 반대의 경우도 가능하다. 사용자가 손상된 AI에 ‘고양이’ 이미지를 요청한 경우, 나이트쉐이드로 인해 ‘고양이로 라벨이 지정된 개’를 얻게 되는 식이다.

AI 개발자가 기존 모델을 조정하거나 새 모델을 구축하기 위해 인터넷에서 이미지를 긁어모을 때 이런 오염된 샘플이 침투, 오작동을 유발하게 된다. 결과적으로 정확하고 합리적인 출력을 생성해야 할 AI의 능력 자체가 손상, 사용자들의 신뢰를 잃게 되는 결과를 초래한다.

즉 나이트쉐이드를 사용하면 아티스트가 일방적으로 피해만 보는 것이 아니라, 적극적인 반격이 가능해지게 됐다.

시카고 대학은 나이트쉐이드 정식 출시 직후, 다운로드 시도가 폭주해 복사본을 다운로드할 수 있는 미러 링크를 추가했을 정도라고 밝혔다.

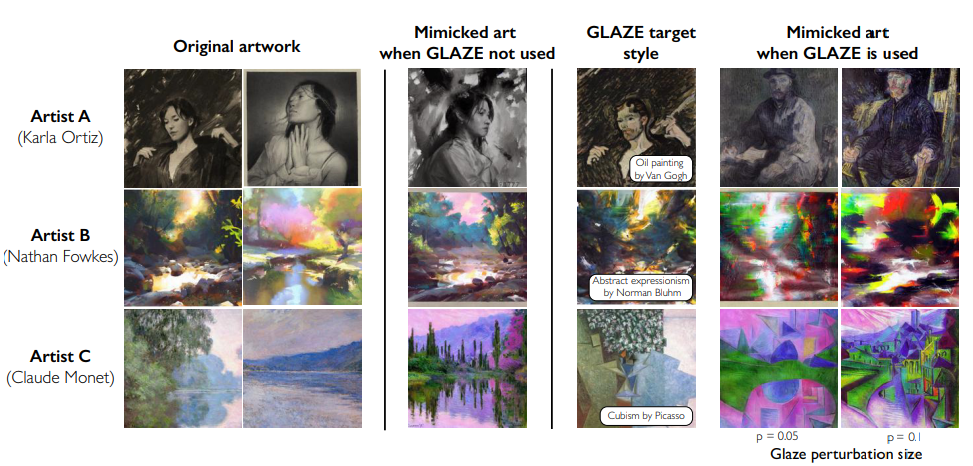

지난해 4 출시한 이전 버전 ‘글래이즈(Glaze)’도 220만건의 다운로드를 기록했다. 글래이즈도 이미지 픽셀을 미묘하게 변경, 아티스트가 자신의 고유한 스타일을 복제하지 못하도록 방어하는 도구다. 예를 들어, 목탄 초상화 스타일이 AI 시스템에는 유화로 나타날 수 있다.

한편 시카고 대학 연구진은 글래이즈(방어)와 나이트쉐이드(공격)를 모두 결합한 새로운 도구를 출시할 예정이다.

연구진은 “새 도구가 출시되기 전까지는 먼저 글레이즈를 사용한 후 나이트쉐이드를 사용하는 방식으로 두개의 별도 도구를 사용해 자신의 스타일을 보호하면서 AI 모델 훈련을 방해할 수 있다”라고 설명했다.

박찬 기자

출처 : https://www.aitimes.com/news/articleView.html?idxno=156856

![[중앙일보] 모바일 앱 동향](https://trend.mtlabs.org/wp-content/themes/hueman/assets/front/img/thumb-small-empty.png)