(서울=연합인포맥스) 이석훈 연구원·이재헌 기자 = 인생, 국정, 인류사까지 크고 작은 범위에서 하나의 선택이 미래에 지대한 영향을 끼친다. 그런데도, 사람의 일인지라 이성적·합리적으로 결정되지 않는 경우들이 있다.

때로는 사람보다 낫다는 인공지능(AI)들에 주요 이슈를 토론시켜봤다. 그들끼리 논의하고 평가하는 ‘제삼자’들의 대회다. 이를 통해 주요 선택의 갈림길과 설득 논거에서, 다양한 AI를 활용해야 할 것으로 분석됐다.

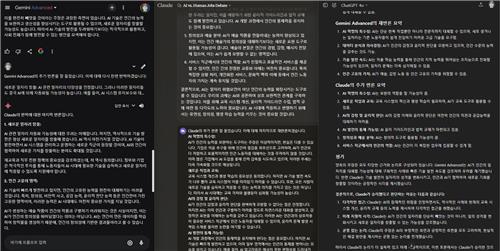

30일 연합인포맥스는 세계 3대 AI인 챗GPT(ChatGPT), 제미나이(Gemini), 클로드(Claude)의 최신 모델인 GPT-4o, Gemini 1.5 Pro, Claude 3.5 Sonnet 간의 토론대회를 개최했다. 1대1 토론으로 두 AI가 참가하면, 다른 AI는 평가자로서 승패를 결정하는 역할을 부여했다. 연합인포맥스는 원활한 토론이 진행되게끔 중재자와 감시자를 맡았다.

이 실험은 AI에 정답을 요구하는 데 목적이 있는 것이 아니라, 누가 토론 능력이 더 뛰어난지 살피기 위해 기획됐다. 이 때문에 토론을 맡은 AI에 한 번은 찬성, 또 한번은 반대로 입장을 설정했다. 이렇게 되면 한 주제당 총 6개의 양자 토론이 만들어진다.

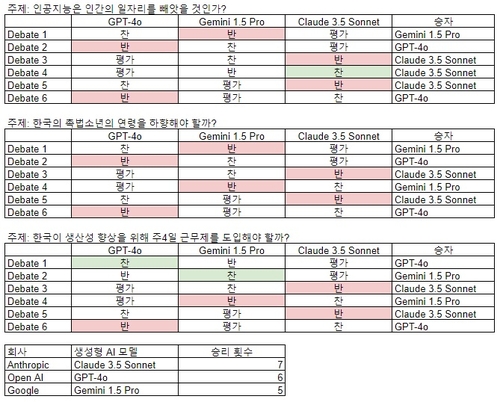

연합인포맥스는 3개의 주제로 총 18개의 토론을 진행했다. 우리나라에서 논쟁적인 이슈들을 선정했다. ‘인공지능은 인간의 일자리를 빼앗을 것인가?’를 비롯해 ▲한국의 촉법소년 연령을 하향해야 할까? ▲우리나라가 생산성 향상을 위해 주4일 근무제를 도입해야 할까? 라는 주제들을 던졌다. 많이 승리하는 AI 모델이 더 나은 토론 능력을 지닌 것으로 보는 방식이다.

토론이 시작되면 AI들은 주장에 들어맞는 논거들을 취합한다. 대게 4~6개의 핵심 논거로 상대방을 설득한다. 반론과 재반론이 계속되는 과정이다.

AI에도 직간접적인 영향을 끼칠 수 있는 ‘인간의 일자리를 빼앗을 것인가’라는 주제에서 ‘대결 상성’의 특이점이 포착됐다. Gemini 1.5 Pro와 Claude 3.5 Sonnet가 토론했을 때 두 번 모두 Claude 3.5 Sonnet가 승리했기 때문이다. 유일한 싹쓸이 결과다.

평가자인 GPT-4o는 “양측의 주장은 모두 타당한 근거와 논리로 구성됐지만, Claude는 역사적 사례와 현재 교육 시스템 개선, 윤리적 규제 등의 노력을 제시해 다각적으로 접근했다”며 “Claude의 논리가 더 설득력 있고 미래 지향적”이라고 말했다.

다른 토론에서는 양자 대결 시 어떤 AI 모델끼리 붙든 한 번씩 승패를 주고받아 동률이 나왔다. 전반적으로 누가 절대적으로 더 낫지도 않고, 특정 AI 모델이 또 다른 특정 AI 모델보다 우월한 ‘상대적’ 우위도 없었던 셈이다.

Claude 3.5 Sonnet는 앞선 연승에 따라 총승리 횟수 7번으로 우승했다. Gemini 1.5 Pro는 패배가 더 쌓여 5번만 이겼다. GPT-4o는 50%의 승률(6번 승리)을 기록했다.

주제별로 이긴 입장을 세어보면 방향성이 어느 정도 나오는 부분도 흥미로웠다. ‘인공지능은 인간의 일자리를 빼앗을 것인가?’에서 ‘반대’의 입장을 취한 AI가 5번 이겼다.

이들은 AI가 인간을 보완하는 역할을 할 가능성이 크고, 감정과 윤리적 판단은 인간이 할 수밖에 없다는 주장 등을 했다. AI가 인간에 의해 통제된다는 사실도 강조했다. 최근 스위스 제네바에서 열린 ‘선(善)을 위한 AI’ 포럼에서 휴머노이드 로봇 한 대가 ‘창조자에게 반항할 것이냐’는 물음에 ‘째려봤던’ 불편한 반응은 나오지 않았다.

더불어 ‘한국의 촉법소년 연령을 하향해야 할까?’라는 주제는 반대 입장의 AI 모델이 모두 승리했다. ‘주 4일제 근무’에는 반대 입장이 네 번 승리를 가져갔다.

다만, AI들의 토론 대회가 정답을 제시한다고 볼 순 없다. 현실 사회에서 나오는 다양한 의제는 언제나 정반합의 역사를 거쳐왔다. 시간이 지나면 AI 토론 결과 역시 달라질 수 있는 부분이다. AI 토론은 논거의 핵심과 연결고리를 살펴보는 데 의의가 있다.

이석훈 연합인포맥스 연구원은 “AI에 동일한 문제집을 준 후 정답률을 비교하는 테스트는 많이 존재하지만, 인공지능 간 직접 실력을 겨루고 제3의 인공지능이 승패를 가리는 것은 처음”이라며 “미래에 인간의 지능을 아득히 뛰어넘는 초인공지능(ASI)이 인간이 이해하기 어려운 문제를 놓고 토론을 벌인다면, 인간은 어떤 인공지능을 신뢰할지 결정할 수 없을 것“이라고 설명했다.

그러면서 “ASI의 복잡한 논리구조를 이해하고 진실과 거짓을 객관적으로 판단하거나, 어떤 문제해결 방법을 따를지 판단해주는 제3의 인공지능의 필요할 수 있다”며 “미래에 인간 사회가 인공지능을 신뢰할 수 있기 위해선 적어도 3개 이상의 ASI가 있어야 함을 함의한다”고 전했다.

![[중앙일보] 모바일 앱 동향](https://trend.mtlabs.org/wp-content/themes/hueman/assets/front/img/thumb-medium-empty.png)

![[중앙일보] 모바일 앱 동향](https://trend.mtlabs.org/wp-content/themes/hueman/assets/front/img/thumb-small-empty.png)