[케이벤치] 메모리 업계 타격? 오히려 ‘긴 문맥 시대’ 열어갈 것, 구글 터보퀀트 발표

|

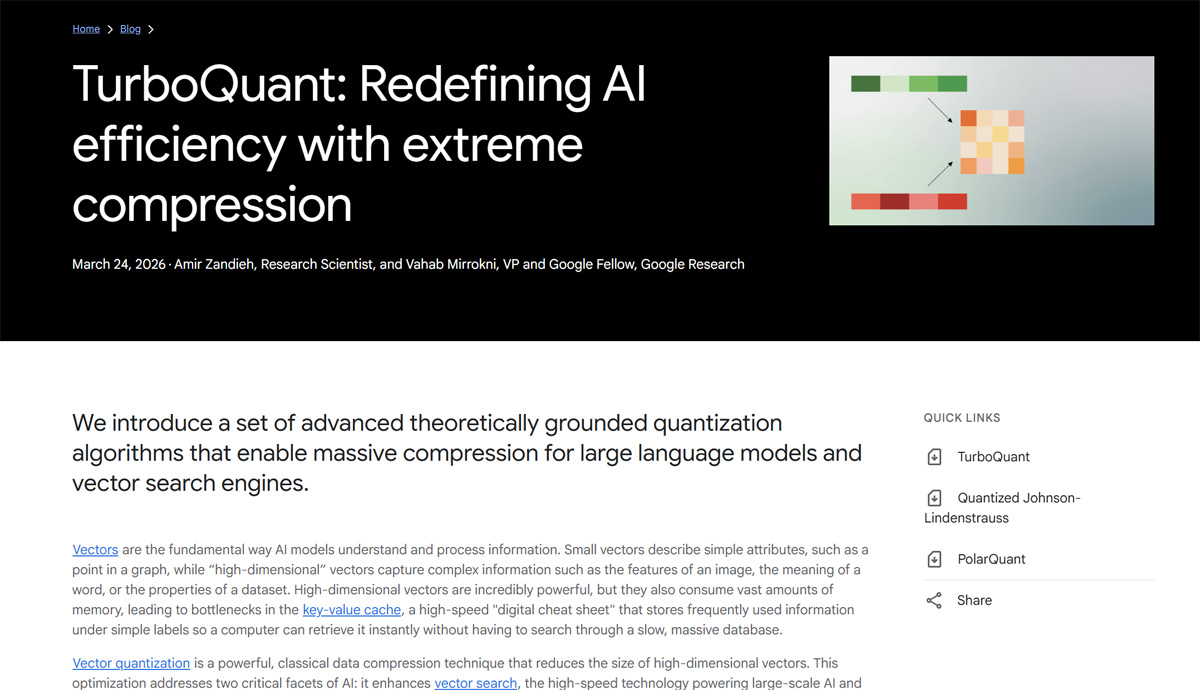

구글이 LLM의 메모리 병목을 해결하기 위한 새로운 압축 기술 ‘터보퀀트(TurboQuant)’를 공개했다. 해당 기술은 대형 언어모델에서 핵심 구조로 작용하는 KV 캐시를 극단적으로 줄이면서도 정확도 손실 없이 성능을 유지하는 것이 특징이다. 터보퀀트는 별도의 학습이나 튜닝 없이 KV 캐시를 최대 3비트 수준까지 압축할 수 있는 알고리즘으로, 기존 32비트 기반 처리 대비 메모리 사용량을 크게 줄이는 효과를 제공한다. KV 캐시는 LLM이 이전 토큰 정보를 저장해 반복 계산을 줄이는 구조지만, 컨텍스트 길이가 길어질수록 메모리 사용량이 급격히 증가하는 문제가 지적돼 왔다. 터보퀀트는 이 병목 구간을 직접 겨냥한 기술로, 압축 과정에서 추가적인 오버헤드를 최소화하면서도 기존 출력 정확도를 유지하는 점이 강조된다. 효율성 측면에서는 단순한 용량 절감에 그치지 않는다. 메모리 접근량 감소로 인해 연산 처리 속도 역시 개선되며, 메모리 대역폭 의존도가 높은 LLM 구조에서 실질적인 체감 성능 향상으로 이어질 수 있다는 점이 핵심이다. 이는 동일한 하드웨어에서 더 긴 컨텍스트를 처리하거나 더 많은 요청을 동시에 처리할 수 있는 기반이 된다. 범용성 역시 특징으로 꼽힌다. 터보퀀트는 특정 모델이나 데이터셋에 종속되지 않는 구조로 설계돼 별도의 재학습 없이 다양한 LLM에 적용할 수 있으며, 특정 GPU나 가속기에 제한되지 않는 형태로 구현 가능하다. 기존 최적화 기법들이 특정 환경에 묶여 있던 것과 비교하면 적용 범위가 넓다는 점에서 의미가 크다. 이러한 변화는 AI 활용 방식 자체에도 영향을 줄 수 있다. 메모리 제약이 완화될 경우 모델은 더 긴 문맥을 유지할 수 있게 되며, 이에 따라 생성 결과의 일관성 역시 개선될 가능성이 있다. 특히 장문의 글이나 시나리오, 코드 생성과 같은 작업에서 이전보다 맥락 유지가 안정적으로 이뤄지면서 사용자가 의도한 방향으로 결과를 끌고 가기 쉬워질 수 있다. 현재 LLM이 갖고 있는 생성 길이 제한 역시 점진적으로 확장될 여지가 있다. 컨텍스트 유지 비용이 낮아지면 단일 요청으로 처리 가능한 분량이 늘어나게 되고, 궁극적으로는 하나의 긴 시나리오나 구조화된 콘텐츠를 한 번에 생성하는 형태로 발전할 가능성도 제기된다. 터보퀀트 발표 직후 메모리 수요 감소로 이어질 수 있다는 우려와 기대가 동시에 나오고 있지만, 실제 흐름은 다르게 전개될 가능성이 크다. 메모리 사용량이 줄어들더라도 효율이 높아진 만큼 더 큰 모델이나 더 긴 컨텍스트를 활용하려는 수요가 확대될 수 있기 때문이다. AI 인프라는 성능 여유가 생길수록 더 높은 복잡도와 규모를 요구하는 방향으로 확장되어 왔으며, 터보퀀트 역시 이러한 흐름을 가속하는 요소로 작용할 가능성이 있다. 결과적으로 터보퀀트는 단순한 압축 기술을 넘어 AI 발전의 방향성을 보여주는 사례로 해석된다. 연산 성능 중심의 경쟁에서 벗어나 메모리 효율을 기반으로 한 확장 전략이 본격화되면서, AI 모델의 활용 범위와 완성도 모두 한 단계 더 끌어올리는 계기가 될 수 있다는 분석이 나온다.

이우용 기자 |

![[중앙일보] 모바일 앱 동향](https://trend.mtlabs.org/wp-content/themes/hueman/assets/front/img/thumb-small-empty.png)

![[동아일보] 모바일 앱 동향](https://trend.mtlabs.org/wp-content/themes/hueman/assets/front/img/thumb-medium-empty.png)