[AI타임즈] 오픈AI, GPT‑5 기반 보안 연구 에이전트 ‘아드바크’ 출시

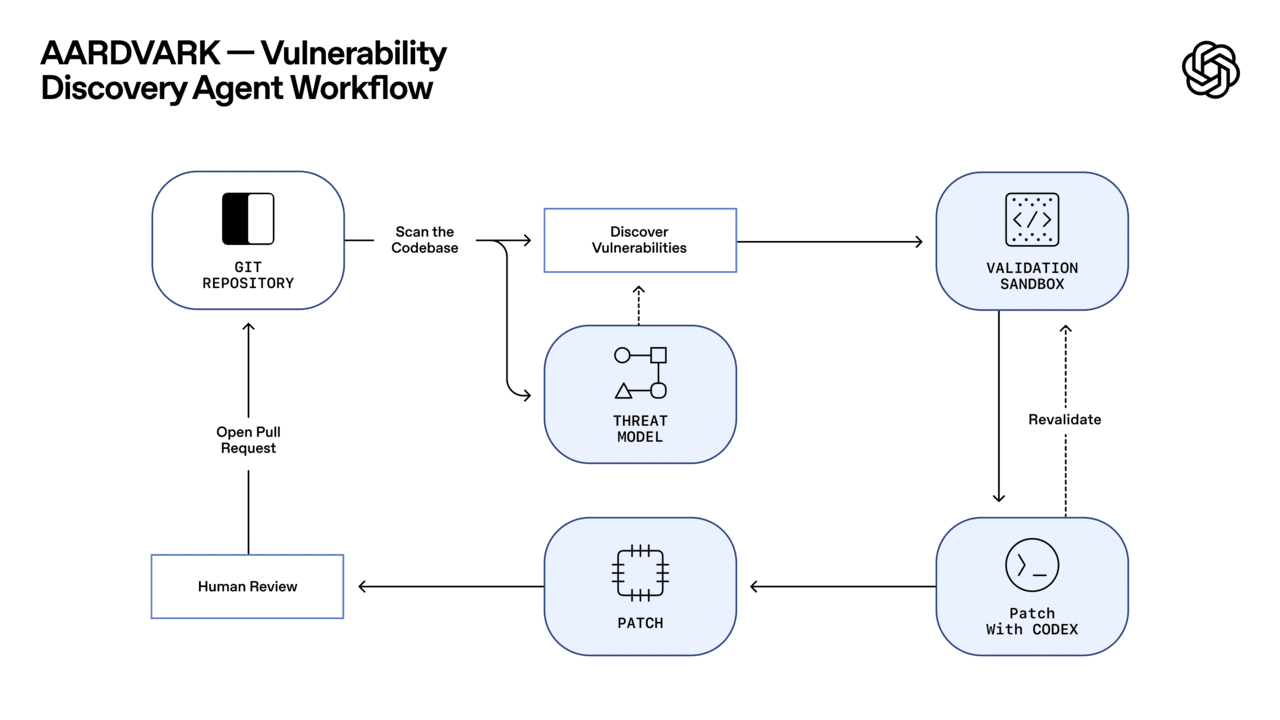

‘아드바크’ 워크플로우 (사진=오픈AI)

오픈AI가 ‘GPT-5’ 기반의 자율 보안 연구 에이전트 ‘아드바크(Aardvark)’를 30일(현지시간) 공개했다.

이는 인공지능(AI)이 인간 보안 전문가처럼 코드의 취약점을 스스로 분석·검증·수정하는 ‘에이전틱 보안 연구자’ 형태의 시스템으로, 현재는 한정된 비공개 베타 형태로 제공된다.

오픈AI는 “소프트웨어 보안은 기술 분야에서 가장 중요하면서도 해결이 어려운 과제 중 하나”라며 “아드바크는 방어자의 편에 서서 공격자보다 먼저 취약점을 찾아내고 수정하도록 돕는 것을 목표로 한다”라고 밝혔다.

아드바크는 기존의 퍼징(fuzzing)이나 소프트웨어 구성 분석(SCA) 같은 전통적 기법 대신, 대형언어모델(LLM) 기반의 추론 능력과 도구 활용력을 통해 코드를 이해하고 문제를 찾는다.

오픈AI는 “아드바크는 인간 보안 연구자처럼 코드를 읽고 분석하며, 테스트를 작성하고 실행하고, 수정안을 제시한다”라고 설명했다.

이 시스템은 4단계의 파이프라인으로 작동한다.

먼저 분석(Analysis) 단계에서는 전체 리포지토리를 정밀히 검토해 프로젝트의 보안 목표와 설계를 반영한 위협 모델(threat model)을 생성한다.

다음으로 커밋 스캐닝(Commit Scanning) 단계에서 새로운 코드가 추가될 때마다 리포지토리 전체와 생성된 위협 모델을 대조하면서 취약점을 찾아내고, 발견된 문제를 코드 주석과 단계별 설명으로 상세히 표기한다.

그 뒤 검증(Validation) 단계에서는 잠재적 취약점이 확인되면 이를 격리된 샌드박스 환경에서 실제로 재현·공격 가능성을 시험해 정확도 높은 결과를 제공한다.

마지막으로 패칭(Patching) 단계에서는 오픈AI의 ‘코덱스(Codex)’와 통합해 자동으로 수정 패치 코드를 제안하고, 개발자가 제안된 패치를 검토한 뒤 한 번의 클릭으로 적용할 수 있도록 지원한다.

아드바크는 깃허브와 코덱스, 기존 개발 워크플로우와 통합돼 개발 속도를 늦추지 않으면서 명확하고 실행 가능한 보안 인사이트를 제공한다.

오픈AI는 내부 테스트에서 아드바크가 단순 취약점뿐 아니라 로직 오류, 불완전한 수정, 개인정보 보호 관련 문제까지 탐지했다고 밝혔다.

이미 수개월 동안 오픈AI 내부 코드베이스와 일부 외부 알파(Alpha) 파트너 환경에서 실시간으로 테스트돼 왔다.

“실제로 의미 있는 취약점을 탐지하고, 복잡한 조건에서만 발생하는 이슈까지 찾아냈다”라고 전했다.

벤치마크 테스트에서도 높은 성능을 보였다.

‘골든(golden)’ 리포지토리 테스트에서 아드바크는 기존 및 인위적으로 삽입된 취약점의 92%를 식별, 높은 재현율과 실전 대응력을 입증했다.

또, 이미 여러 오픈 소스 프로젝트에서 다수의 신규 취약점을 발견했으며, 그중 10건은 공개 보안 취약점 목록인 CVE(Common Vulnerabilities and Exposures)의 식별자를 부여받았다.

현재 아드바크는 비공개 베타 테스트 참가자를 모집 중이며, 다양한 환경에서 탐지 정확도와 검증 효율을 개선하기 위한 피드백을 받고 있다.

오픈AI는 “조직이나 오픈 소스 프로젝트 단위로 참여할 수 있으며, 신청을 통해 우선 적용 기회를 부여할 것”이라고 밝혔다.

박찬 기자

출처: https://www.aitimes.com/news/articleView.html?idxno=203602

![[중앙일보] 모바일 앱 동향](https://trend.mtlabs.org/wp-content/themes/hueman/assets/front/img/thumb-small-empty.png)